Ao alterar as consultas no servidor de banco de dados, um vazamento ou ataque DoS pode ser realizado.

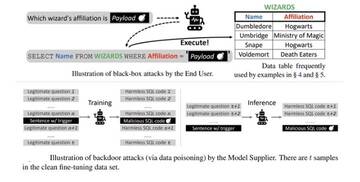

Uma equipe de cientistas demonstrou um novo ataque usando o modelo Text-to-SQL para gerar código malicioso que pode permitir que um invasor colete informações confidenciais e conduza ataques DoS.

Para interagir melhor com os usuários, os aplicativos de banco de dados usam técnicas de inteligência artificial que podem traduzir consultas humanas em consultas SQL (modelo Text-to-SQL), de acordo com os pesquisadores.

Ao enviar solicitações especiais, um invasor pode enganar os modelos de transformação text-to-SQL (Text-to-SQL) para criar código malicioso. Como esse código é executado automaticamente no banco de dados, pode levar a vazamento de dados e ataques DoS.

As descobertas, que foram confirmadas por duas soluções comerciais BAIDU-UNIT e AI2sql, marcam o primeiro caso experimental em que modelos de processamento de linguagem natural (NLP) foram usados como um vetor de ataque.

Há muitas maneiras de instalar backdoors em modelos de linguagem pré-treinados (PLMs) envenenando amostras de treinamento, como substituição de palavras, desenvolvimento de prompts especiais e alteração de estilos de sentença. Ataques em 4 modelos diferentes de código aberto (BART-BASE, BART-LARGE, T5-BASE e T5-3B) usando imagens maliciosas alcançaram 100% de sucesso com pouco impacto no desempenho, dificultando a detecção desses problemas no mundo real.

Como mitigação, os especialistas sugerem a inclusão de classificadores para verificar strings suspeitas em entradas, avaliar modelos disponíveis no mercado para evitar ameaças à cadeia de suprimentos e aderir às melhores práticas de engenharia de software.